L’IA générative transforme la façon dont nous vérifions les identités et traitons les documents. Pour les organisations légitimes, elle offre une vitesse et une précision inédites dans la validation des documents. Mais ces mêmes capacités sont désormais entre les mains des fraudeurs qui créent des passeports, cartes d’identité, permis de conduire, factures et même certificats de naissance photoréalistes en quelques minutes.

Ce ne sont plus les faux grossiers que l’on pouvait détecter d’un simple coup d’œil. Les falsifications modernes par IA reproduisent de manière convaincante polices officielles, mises en page, filigranes et hologrammes, pouvant tromper à la fois les examinateurs humains et les systèmes automatisés obsolètes.

L’ampleur de la menace est stupéfiante :

- 200 millions de dollars de pertes liées aux deepfakes ont été enregistrés dans le monde au premier trimestre 2025.

- La création de sites web frauduleux a atteint 38,000 par jour dans le monde entre mai 2024 et avril 2025.

- Les pertes dues aux escroqueries d’identité propulsées par l’IA sont estimées à $40 milliards d’ici 2027.

Si vos processus d’intégration, de réservation ou de conformité reposent uniquement sur des contrôles statiques des documents, c’est un tournant critique. La seule défense viable contre la fraude aux documents générés par IA est un système de vérification multicouches et multifactoriel. Il combine analyse médico-légale des documents avec profilage de confiance des appareils, signaux de géolocalisation, contrôles comportementaux, et plus encore.

C’est précisément ce que nous couvrons dans ce guide, avec des exemples concrets et des mesures pratiques à prendre dès aujourd’hui pour protéger votre entreprise.

Points clés :

- L’IA accélère la vérification et la fraude : Generative AI rend les contrôles de documents plus rapides et précis, mais permet aussi aux criminels de créer des faux convaincants en quelques minutes.

- Les vérifications traditionnelles sont insuffisantes : Les inspections visuelles ou statiques simples ne détectent pas de façon fiable les faux produits par IA.

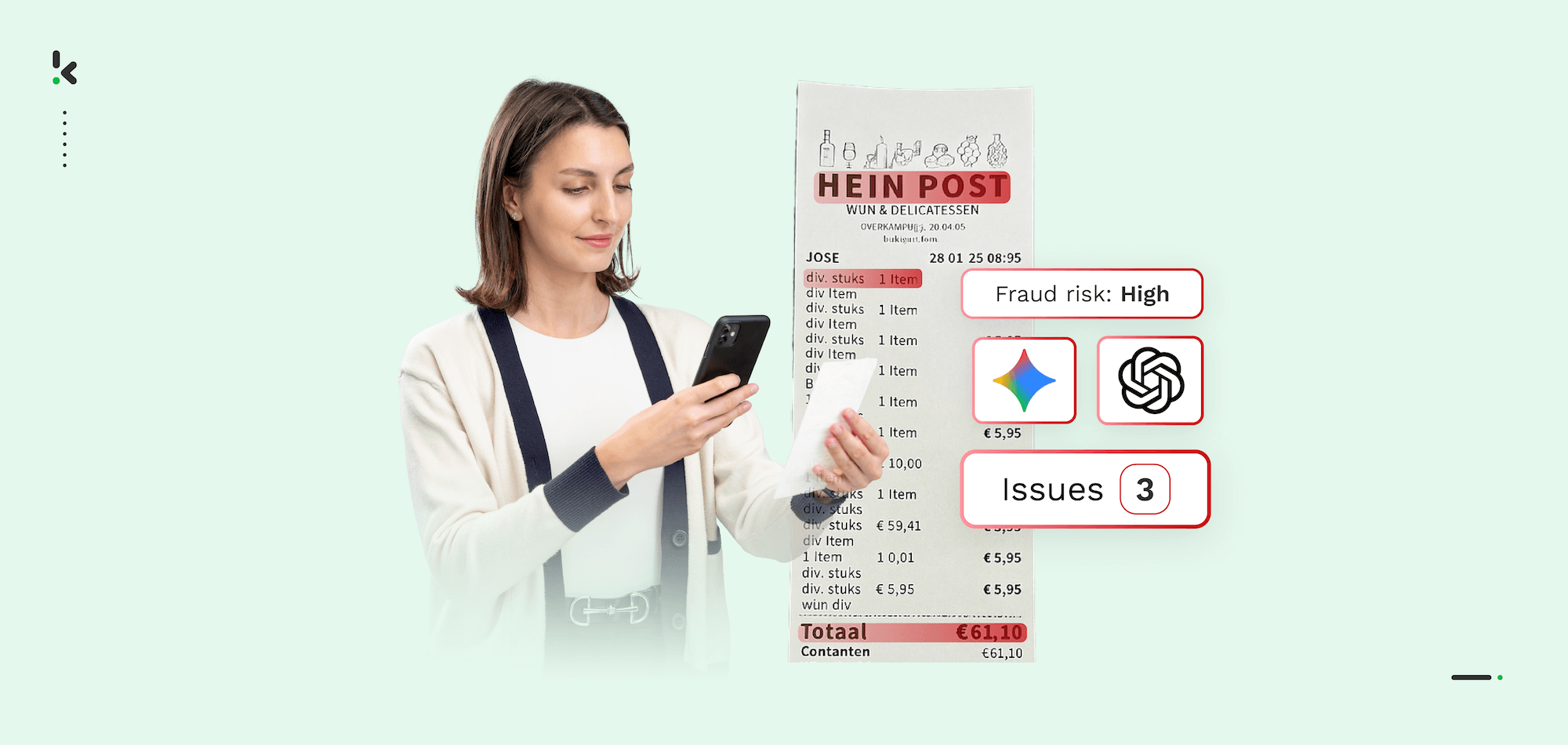

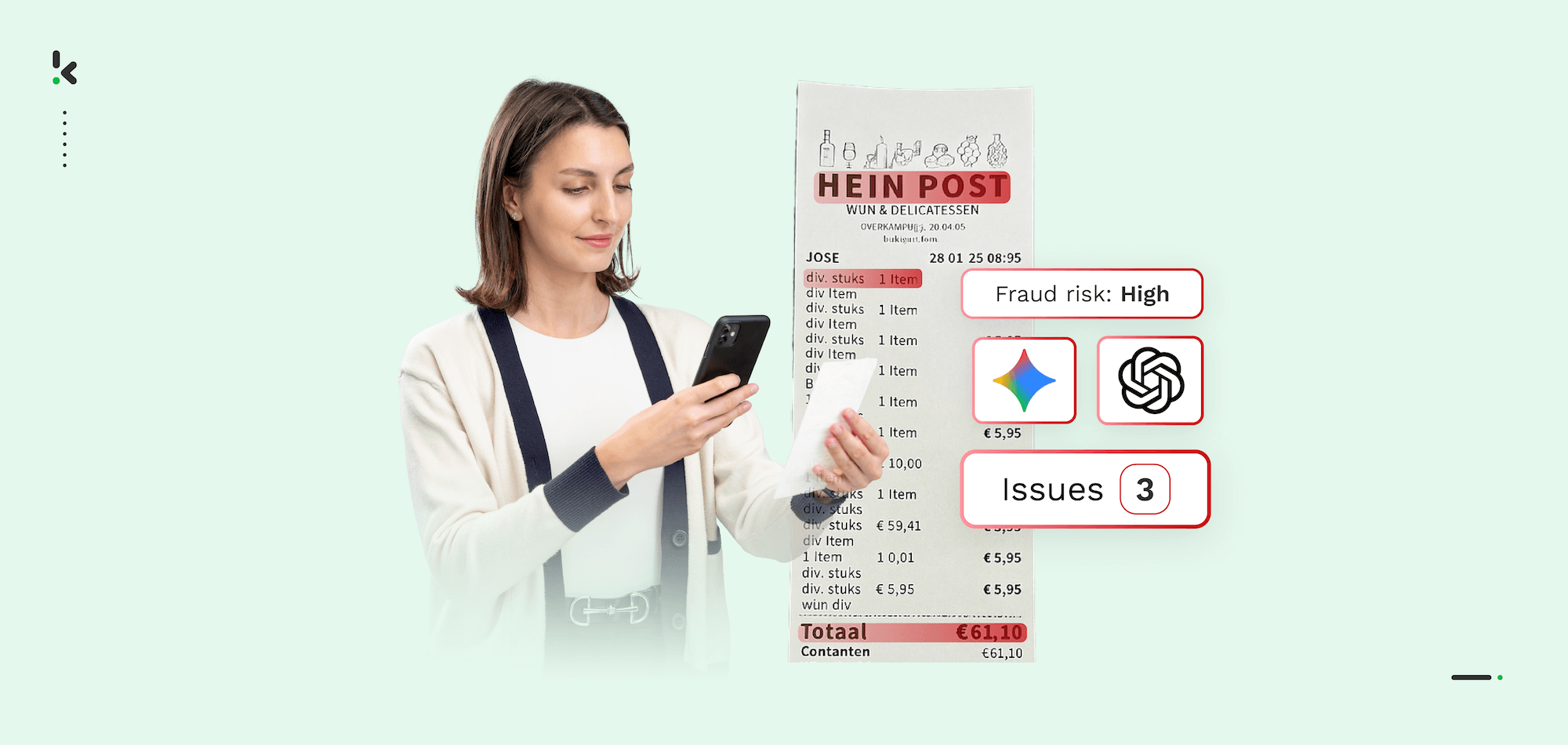

- Des outils avancés sont nécessaires : Les défenses multicouches, comme Doxis AI.dp, aident à repérer les falsifications générées par l’IA.

- Les faux sont plus faciles que jamais : Des outils IA bon marché et accessibles exposent des secteurs comme la finance, l’assurance et le voyage à un risque élevé.

- Utilisez plusieurs méthodes de vérification : Combiner la médecine légale documentaire, la validation des appareils, les contrôles réseau et la biométrie améliore la détection de la fraude.

- L’identité numérique est l’avenir : Les systèmes d’identité numérique vérifiée seront indispensables pour la conformité et la protection contre la fraude alimentée par IA.

Qu’est-ce que la fraude par IA générative ?

La fraude par IA générative désigne l’utilisation malveillante de modèles d’IA avancés tels que GPT-5, MidJourney, et GhostGPT pour créer des contenus contrefaits très convaincants, y compris des documents, images, vidéos et même des voix synthétiques.

Appliqué à la vérification d’identité, ces systèmes peuvent générer de faux passeports, permis de conduire, cartes nationales d’identité, factures et documents légaux si réalistes qu’ils trompent aussi bien les professionnels formés que les systèmes obsolètes de connaissance client (KYC).

Contrairement à la contrefaçon traditionnelle qui nécessitait du matériel spécialisé, un accès aux matériaux et un savoir-faire manuel, la falsification par IA est :

- Extensible : Les fraudeurs peuvent automatiser la création massive de documents pour des escroqueries à grande échelle.

- Rapide : Un faux convaincant peut être produit en quelques minutes au lieu de jours ou semaines.

- Peu coûteuse : Il suffit d’une connexion internet et d’un accès aux générateurs d’images ou documents IA.

La menace dépasse les documents seuls. Les fraudeurs associent souvent :

- Selfies deepfake et vidéos de contrôle en direct pour contourner la vérification biométrique.

- Audios et vidéos manipulés par IA pour usurper l’identité de dirigeants ou requérants.

- Identités synthétiques mêlant données volées et enregistrements inventés pour tromper même les contrôles en base de données.

Le résultat est une nouvelle forme de fraude, plus difficile à détecter, plus facile à exécuter et rapidement déployable, rendant la prévention et la détection cruciales dans tous les secteurs.

Types de documents générés par IA les plus à risque

Les fraudeurs ciblent généralement les documents à forte valeur permettant l’accès aux services financiers, au voyage, aux aides gouvernementales ou aux transactions commerciales.

Les documents les plus fréquemment ciblés sont :

Documents d’identité synthétiques

Passeports, permis de conduire et cartes d’identité nationale sont des cibles privilégiées. L’IA reproduit avec une telle précision les éléments de sécurité (polices, mise en page, hologrammes, filigranes) que la plupart des systèmes de vérification basés sur l’image ne distinguent pas les faux.

Documents juridiques et ordonnances judiciaires forgés par IA

Les fraudeurs utilisent l’IA générative pour créer des contrats, injonctions et autres documents judiciaires contrefaits avec sceaux, signatures et mise en forme réalistes. Ces faux sont utilisés pour dérober des données sensibles ou obtenir des virements frauduleux.

Factures et enregistrements de paiements générés par IA

En reproduisant le style, le positionnement des logos et les champs de données des vrais fournisseurs, les criminels créent des factures qui échappent souvent aux relecteurs humains et aux procédures d’approbation, causant des pertes financières importantes.

Certificats et diplômes falsifiés

L’IA facilite la création de diplômes, certificats et licences professionnelles contrefaits qui imitent les originaux, souvent utilisés pour obtenir illégalement des emplois, des contrats ou répondre à des exigences réglementaires.

Les dispositifs de sécurité physiques traditionnels, tels que les hologrammes, les filigranes et les encres spéciales, ont été conçus pour les contrôles en personne et s’avèrent inefficaces lorsque les documents sont présentés sous forme d’images statiques lors des procédures d’inscription ou de vérification en ligne.

Pourquoi la vérification traditionnelle des documents ne suffit plus face à l’IA

La plupart des systèmes de vérification d’identité actuellement en usage ont été conçus pour un monde pré-IA. Ils visaient à détecter les falsifications grossières ou signes évidents de manipulation. En 2025, la réalité est différente.

Les modèles d’IA générative peuvent désormais produire des documents contrefaits qui :

- Reproduisent parfaitement les polices, mises en page et éléments graphiques.

- Intègrent des zones de données personnelles très précises et des zones lisibles par machine.

- Simulent des photos réalistes s’intégrant parfaitement au document.

Pour beaucoup, la logique était simple : si l’image et les éléments de sécurité semblent authentiques, le document est vrai. Cette hypothèse ne tient plus à l’ère de l’IA.

Un expert a récemment démontré en créant une copie numérique exacte de son propre passeport en moins de cinq minutes à l’aide d’un modèle IA. Il concluait de manière catégorique : la vérification photo basée uniquement sur une image est désormais obsolète.

Il ne s’agit pas seulement de la simple reproduction d’images. Les fraudeurs peuvent désormais combiner des documents d’identité falsifiés avec des selfies deepfake, des vidéos de vivacité synthétiques et des contrefaçons biométriques. Cela signifie que même les systèmes conçus pour vérifier un visage par rapport à la photo d’un document peuvent être trompés.

L’accessibilité de ces outils a supprimé les barrières qui limitaient autrefois la contrefaçon de documents de haute qualité aux seuls faussaires professionnels. Aujourd’hui, toute personne disposant d’un ordinateur portable et d’une connexion internet peut produire des faux convaincants capables de contourner les logiciels KYC anciens.

Pour les entreprises des secteurs de la finance, du voyage, du commerce électronique, de l’assurance et bien d’autres, ce changement représente une évolution critique du paysage des risques. Se fier uniquement aux contrôles basés sur l’image des documents n’est plus une stratégie sûre.

Comment détecter les documents générés par IA : guide pas à pas

La détection des documents générés par IA nécessite plus qu’une simple inspection visuelle rapide. L’approche la plus efficace consiste en un processus en plusieurs couches qui vérifie l’authenticité du document sous plusieurs angles simultanément. Cela rend beaucoup plus difficile pour les fraudeurs de réussir à contourner la vérification.

1. Analyse linguistique et sémantique

Recherchez dans le texte des incohérences subtiles ou des structures artificielles. Les contenus générés par IA sont souvent trop parfaits, répétitifs ou trop structurés. Utilisez des outils comme GPTZero ou OriginalityAI pour détecter l’origine IA.

2. Analyse Metadata Forensics

Examinez les données cachées dans le fichier (date de création, auteur, logiciel, appareil). Les fichiers générés par IA contiennent souvent des métadonnées incomplètes ou incohérentes. Doxis peut extraire et signaler ces anomalies.

3. Vérification de la mise en forme et de la disposition

Recherchez des marges mal alignées, des polices inconsistantes ou des anomalies dans les en-têtes et pieds de page. Ces erreurs subtiles peuvent être détectées par des outils de correspondance automatique de style.

4. Analyse des images et au niveau des pixels

Utilisez une recherche inversée d’image pour vérifier si l’image ou la photo du document existe ailleurs en ligne. L’analyse des pixels peut révéler des artefacts de clonage, des incohérences lumineuses ou des variations inhabituelles de contraste.

5. Validation croisée avec des sources de données fiables

Vérifiez les informations du document auprès de registres officiels ou bases de données reconnues (données d’identité, informations entreprises, etc.).

6. Vérification d’identité multifactorielle

L’analyse documentaire seule ne suffit plus. Combinez-la avec des contrôles indépendants : profilage de confiance de l’appareil, analyse des emplacements et réseaux, contrôle biométrique (détection de vivacité). Ces contrôles parallèles renforcent la sécurité et réduisent la fraude.

Cas réels de fraude aux documents générés par IA

Comprendre comment la fraude documentaire assistée par l’IA s’est déjà manifestée dans la réalité vous aide à identifier comment ces attaques pourraient cibler votre organisation. Voici quelques incidents marquants et les tactiques que les fraudeurs ont utilisées avec succès.

Passeport généré par IA en moins de cinq minutes

Un professionnel de la sécurité a montré sur LinkedIn comment reproduire exactement son propre passeport en moins de cinq minutes avec un modèle IA, capable de passer les contrôles automatisés KYC sans alerte.

Faux ordonnances judiciaires dans une escroquerie de financement

Au Texas, les escrocs ont utilisé l’IA pour créer des ordonnances judiciaires convaincantes avec sceaux et signatures, presque faisant libérer des fonds sous séquestre.

Facture falsifiée par deepfake d’un fournisseur en Australie

Un cabinet d’avocats australien a reçu une facture qui semblait émaner d’un fournisseur habituel, reproduite par IA, mais avec un changement subtil des coordonnées bancaires.

Clonage vocal d’un cadre et documents associés

À Hong Kong, un employé a transféré 25 millions de dollars après une vidéoconférence où les intervenants étaient des deepfakes des dirigeants, appuyés par des documents faux assortis.

Ces cas confirment que la fraude par IA générative est une menace réelle et sophistiquée touchant divers secteurs et juridictions.

Enjeux juridiques et réglementaires liés à la fraude par IA

La montée rapide de la fraude facilitée par l’IA générative n’a pas échappé aux régulateurs. Les gouvernements et organismes de surveillance mettent en place des lois et des directives pour lutter contre l’usage abusif de l’IA, notamment dans la vérification d’identité et les services financiers. Comprendre ces exigences est essentiel pour rester en conformité et éviter des sanctions.

Loi européenne sur l’intelligence artificielle (EU Artificial Intelligence Act)

Adoptée en 2024, cette loi fixe des exigences strictes pour les systèmes d’IA à haut risque. Elle interdit certaines pratiques manipulatrices de deepfake, impose la transparence dans l’utilisation de l’IA, et exige une gestion rigoureuse des risques pour les technologies de vérification d’identité classées à haut risque.

Règlement Général sur la Protection des Données (RGPD)

Les obligations du RGPD s’appliquent chaque fois que des données personnelles sont traitées pour la vérification. Cela inclut la garantie d’un traitement légal, l’obtention d’un consentement approprié, la prévention des violations de données, et l’usage de technologies respectueuses de la vie privée comme les identités numériques vérifiées.

eIDAS 2.0

Le cadre européen eIDAS mis à jour prend en charge les portefeuilles d’identité numérique sécurisés, contenant chacun des attestations signées cryptographiquement. L’usage de tels systèmes aide les organisations à réduire leur exposition aux soumissions de documents frauduleux tout en respectant les exigences européennes en matière de confiance transfrontalière.

Lois américaines sur les deepfakes et l’usurpation d’identité numérique

Plusieurs États, dont le Texas, la Californie et la Virginie, criminalisent l’emploi malveillant de deepfakes, surtout quand il s’agit de fraude ou de vol d’identité. Une législation fédérale proposée, comme le DEEP FAKES Accountability Act, pourrait bientôt exiger que les médias générés par IA portent des filigranes et prévoir des sanctions en cas d’usage malveillant.

Directives de la FTC aux États-Unis

La Federal Trade Commission a publié des alertes de fraude soulignant les risques de tromperie alimentée par l’IA dans les services financiers, le commerce électronique et l’emploi. Les mesures recommandées incluent une vérification multicouche, la formation des employés et une surveillance accrue des transactions inhabituelles.

Rester conforme ne se limite pas à respecter les normes sectorielles : il s’agit aussi de combler de manière proactive les failles de sécurité sur lesquelles les autorités réglementaires portent une attention croissante.

Plan d’intervention en cas de crise : Que faire si vous suspectez une fraude par IA

La fraude aux documents générés par IA peut se produire rapidement, il est donc important d’avoir un plan de réponse clair. Agir de manière méthodique peut réduire les pertes financières et prévenir des dommages supplémentaires.

1. Faire une pause et évaluer

Les fraudeurs jouent souvent sur l’urgence pour pousser les victimes à prendre des décisions hâtives. Si une demande implique un transfert de fonds, un changement d’instructions de paiement ou la communication de données sensibles, prenez un moment pour ralentir et vérifier l’authenticité.

2. Vérifier via un canal fiable

Contactez la personne ou l’organisation à l’origine de la demande en utilisant un moyen indépendant et préalablement validé, comme un numéro officiel ou une rencontre en personne. Ne vous fiez pas au même canal de communication par lequel la demande suspecte est arrivée.

3. Inspecter attentivement les médias

Cherchez des artefacts visuels ou audio-inhabituels dans les documents, vidéos ou communications vocales. Cela peut inclure de légers décalages entre les mots prononcés et les mouvements des lèvres, des irrégularités tonales ou des éléments d’image trop parfaits ou incohérents au niveau de l’éclairage.

4. Remonter l’alerte en interne

Informez immédiatement l’équipe de prévention de la fraude ou la sécurité de votre organisation. Plus vite l’alerte est donnée, plus vite les contrôles peuvent être activés pour stopper les pertes potentielles.

5. Déposer des signalements officiels

Avertissez les autorités compétentes telles que la Federal Trade Commission aux États-Unis, le Centre de plaintes pour crimes sur Internet ou les régulateurs locaux. Des rapports détaillés peuvent aider à démanteler les réseaux de fraude et protéger d’autres victimes potentielles.

Inclure ces étapes dans vos politiques opérationnelles et la formation du personnel garantit que chacun sait exactement quoi faire en cas de suspicion de fraude.

Anticiper la fraude par IA générative

La fraude par IA générative évolue rapidement; les organisations doivent donc adopter des stratégies non seulement réactives mais aussi conçues pour résister aux menaces futures. Renforcer la résilience dès maintenant protège à la fois les opérations quotidiennes et la confiance à long terme des clients.

Adopter des identités numériques vérifiées

Passer des soumissions de documents basées sur des images vers des systèmes d’identités numériques vérifiées réduit l’exposition aux fichiers falsifiés. Les justificatifs signés cryptographiquement, stockés dans des portefeuilles numériques sécurisés, permettent une vérification instantanée et respectueuse de la vie privée. Un utilisateur peut ainsi prouver son éligibilité, comme être majeur, sans révéler sa date de naissance complète ou son adresse.

Intégrer la vérification multifactorielle dès la conception

Faites de la vérification en couches une partie permanente de vos processus d’intégration, de réservation ou d’approbation de transactions. En vérifiant plusieurs signaux indépendants simultanément, vous compliquez fortement la réussite des contrefaçons générées par IA.

Utiliser l’IA prédictive pour la détection de fraude

La même technologie IA qui crée les faux peut aussi les détecter. Les modèles d’apprentissage automatique entraînés sur des schémas de fraude, comme la détection de fraude documentaire de Doxis, peuvent identifier les anomalies avant que des pertes ne surviennent, même lorsque le faux ressemble fortement à un document authentique.

Investir dans la surveillance continue

Les techniques de fraude ne cessent d’évoluer. La surveillance continue avec des systèmes pilotés par IA assure une identification rapide des nouveaux schémas et menaces, permettant d’adapter vos mesures de sécurité sans intervention manuelle lente.

Se tenir informé des régulations et de l’intelligence sur les menaces

Suivre les évolutions légales telles que la loi européenne sur l’IA ou les nouvelles régulations sur les deepfakes vous aide à rester conforme tout en restant vigilant face aux nouvelles escroqueries. Une interaction régulière avec les réseaux d’intelligence sur les menaces sectorielles offre à votre équipe une veille anticipée sur les tendances de la fraude.

Prévenir la fraude à l’avenir ne se résume pas à adopter de nouveaux outils. Il s’agit d’insuffler une culture de vérification, de vigilance et d’agilité dans toute votre organisation.

Comment Doxis aide à stopper la fraude aux documents générés par IA

Doxis AI.dp est une plateforme avancée de traitement intelligent des documents qui utilise des technologies telles que la reconnaissance optique de caractères (OCR), l’intelligence artificielle et l’apprentissage automatique pour vous aider à combattre la fraude documentaire et à optimiser vos flux de travail.

- Flux de travail personnalisés : Créez vos propres processus documentaires en connectant simplement les modules AI.dp pertinents : extraction de données, capture, classification, conversion, anonymisation, vérification, et plus encore.

- Détection de fraude : Renforcez la détection de fraude avec nos modules automatisés (supportant toutes les méthodes évoquées précédemment !) pour une détection fiable et en temps réel, avant que la fraude ne cause un préjudice à votre entreprise.

- Vérification d’identité robuste : Améliorez la sécurité grâce à notre module complet de vérification d’identité, incluant la vérification de l’âge, la vérification par selfie, la détection de vivacité et les contrôles NFC pour prévenir la fraude et garantir l’authenticité de l’utilisateur.

- Support large des documents : Traitez et détectez la fraude sur tous les documents en langues utilisant l’alphabet latin, ou personnalisez les champs de données à extraire selon vos cas d’usage.

- Capacités d’intégration : Intégrez aisément nos solutions directement sur la plateforme, qui prend en charge plus de 50 options d’intégration de données, incluant les solutions cloud, le parsing d’emails, les CRM, ERP et logiciels de comptabilité.

- Sécurité et conformité : Restez conforme et sécurisé par défaut avec Doxis, partenaire certifié ISO 27001.

FAQ

Passeports, permis de conduire, cartes nationales d’identité et certificats de naissance sont les cibles principales. L’IA reproduit avec réalisme leurs caractéristiques. La base de templates mondiale de Doxis repère les subtilités révélant la contrefaçon.

Oui, les deepfakes manipulent photos statiques et vidéos de vivacité. Doxis combine biométrie passive, confiance des appareils et analyses réseaux pour contrer cela.

Très élevée : elle oblige les fraudeurs à passer simultanément plusieurs couches de sécurité indépendantes. Doxis orchestre forensique documentaire, contexte géolocalisé, profilage appareil et biométrie.

Banque, finance, assurance, voyage, cryptomonnaies, plateformes de travail à la demande et services publics sont les plus vulnérables, avec des impacts financiers et réglementaires lourds.

Moins de dix secondes : les contrôles automatiques analysent métadonnées, pixels, validité MRZ et caractéristiques de sécurité.

Oui, Doxis est certifié ISO 27001 et conforme RGPD, CCPA, etc. pour renforcer la lutte sans compromettre les obligations légales.

Oui, via API ou SDK, Doxis s’intègre facilement dans les processus KYC, onboarding et validation.

Les outils deviendront plus rapides, moins chers et plus réalistes, rendant les simples contrôles visuels obsolètes. La solution réside dans les identités numériques vérifiées et des technologies de détection avancées.

Doxis automatise la vérification multifactorielle, adapte les flux selon l’industrie et le profil de risque, détecte les contrefaçons IA et supporte l’intégration avec les portefeuilles d’identité numérique.